李佳城,陈智强(通信作者),王 硕

(1 辽宁工程技术大学测绘与地理科学学院 辽宁 阜新 123000)

(2 辽宁科技大学电子信息与工程学院 辽宁 鞍山 114051)

工业机器人在使用上面临着感知能力不强、无法适应周围环境的问题。通过三维视觉获取场景三维信息,在三维信息引导下计算机器人末端运动轨迹,使得机器人在视觉引导下更好地适应周围环境,这是机器人行业要解决的核心问题。近几年国内对于改进机器人抓取问题的方法在不断发展,在2011年时,张森彦等[1]采用矩形框表示物体抓取位置来替代之前的点抓取法,而采用这种矩形框表达的抓取方法是机器人抓取的新应用,可达到比较理想的效果。随着深度神经网络的发展,神经网络的应用似乎无处不在,在2019年,曹雏清等[2]也设计了一种新的深度神经网络算法,该算法完成机器人对物体的判断和针对判断而形成的位置。随着不同的神经网络方法在机器人抓取问题的尝试,卷积神经网络也被设计出来解决机器人物体抓取的问题,而李传浩[3]、王斌[4]、黄家才等[5]、李秀智等[6]、李鹏飞[7]采用随机森林方法、循环神经网络结合并使用ICP 算法,进一步提高抓取的效果。陈盟等[8]采用层次网络构建抓取姿态的算法,上述抓取位置的构造效果和取得的抓取效率都在逐渐进步。

本文设计了一种轻量级卷积模块Inception-ConCat,该模块将图像用卷积方式构建特征信息,这个过程是信息编码过程,该过程结束后,再采用GRU 网络对物体进行姿态识别,从而控制机械臂运动,形成抓取动作,成功抓住物体。为了验证效果,算法首先在康奈尔数据集上验证,之后在实际工作环境中,使用具有视觉抓取能力的KUKA 机械臂上进行验证,结果表明研究人员所设计的抓取网络运算速度快,抓取准确度高(综合抓取成功率达到96.1%),相对于之前的抓取网络[8],取得良好改善效果。

1.1 抓取位置表示

要实现机器人对于目标检测的目标,最重要的一点是要对机器人抓取目标的位置进行正确的标定,通常研究人员用双指抓手来实现物体抓取,如图1所示,图中的机械手是研究人员自己设计制造的机械手。机器人结构中,其上端是一个三维获取视觉,整个手眼结构为典型的“眼在手上”(Eyes On Hand)结构。

图1 视觉引导双指机械抓手

机器人一般是在现实空间里进行抓取的,需要为机器人提供在三维空间的信息,而三维空间信息有3 个维度的位置信息,包括:机器人机械手的三维位置坐标、抓手的三维旋转方向和抓手两指张开的长度。在相机像素坐标下的表示的三维抓取信息需要通过转移矩阵转移到机器人抓手位置的三维坐标:

其中Tci是机器人使用的相机的内部参数矩阵,包括相机的焦距和像素大小等,Trc是把相机内参矩阵转为机器人空间坐标的矩阵。研究人员可以应用矩形框检测的方法来实现抓取:在检测目标上生成一个矩形框来表示抓手的抓取范围。

如图2所示为抓取检测网络生成的矩形框。

图2 二维抓取网络参数表达

图中,θ表示检测矩形框与水平位置的夹角,(x,y)表示检测矩形框的中心,H表示检测矩形框的高,W表示检测矩形框的宽。

1.2 优化的Inception-ConCat 卷积模块

采用传统的卷积神经网络来表达被抓取物体,其表达要么表达能力有限,要么网络太繁琐,为此研究人员设计了Inception-ConCat 模块进行堆叠,并且利用残差机制防止网络退化。研究人员在卷积神经网络基础上增加Inception 机制,并且结合残差机制防止网络退化,从而给研究人员的网络命名为Inception-ConCat 网络。在此基础上,研究人员基于所提出的Inception-ConCat 模块又改进新的残差结构网络Inception-ConCat-ResNet,结构如图3所示:

图3 Inception-ConCat-ResNet 模块

1.3 编码解码结构的抓取网络

结合前部分提出的自主设计的网络模块,最终设计了一个抓取网络Inception-ConCat GraspNet,这个网络主要是对被抓取物体进行编码,在编码后,对编码结构设计GRU 循环网络进行解码,在解码过程中不断控制机器人各个关节运动,使之最后成功抓取被测物。

抓取网络的工作过程一般分两个阶段进行,第一个阶段是预测出所有可能的抓取位置,第二阶段是对这些可能的抓取位置进行投票,得分最高者就作为最终的抓取位置。这两个阶段的实现需要对应两种不同的神经网络。与一般抓取网络不同的是,Inception-ConCat-GraspNet 是一个端到端的单阶段抓取网络,网络执行一次即可得到结果,本文设计的抓取网络整体框架如图4所示。

在上述结构中,网络由2 个卷积层核心3×3 卷积层、4 个自主设计的 Inception-ConCat-ResNet 模块、全连接层所组成,FC1 隐藏的节点数为1 024,FC2 隐藏的节点数为256,在依次通过这三种网络模块后,可以得到检测目标的矩形框和其他信息。

实验中采用了两个步骤验证抓取网络的效果,首先用康奈尔数据集进行基于图片的抓取效果,然后使用自主设计的具有三维视觉抓取功能的实际视觉机器人验证抓取效果,最后结果证明抓取网络实现的效果理想,总精度达到95.1%,实际应用效果理想。

在下述实验中,研究人员始终采用Jaccard 指数作为验证标准。为了使实验结果能与其他抓取网络做横向的比较,选择在机器人抓取领域比较公认的康奈尔数据集作为实验对象。该数据集提供900 幅的被抓取物体的图像,这些样本像都带有矩形框,共有5 000 多个用于抓取物体的矩形框和将近3 000 个不可用于抓取的矩形框。

为了验证本文所提算法的实际应用价值,研究人员采用实验室自主设计的基于KUKA 机械臂的三维视觉抓取机构验证抓取网络效果,抓取机器人结构如前图1所示。该视觉抓取机器人,研究人员自主设计了带有深度信息的三维环境获取传感器,在三维视觉传感器下方设计了两个手指的抓手,并且将其设计为“眼在手上”结构,经过机械臂视觉标定后,三维视觉抓取机械臂的抓取精度在3 mm以内,完全满足实验中抓取的需求。

2.1 康奈尔数据集样本预处理

康奈尔抓取数据集是验证抓取效果的公共数据集,为了使用该数据集要扩充康奈尔数据集提供的数据信息。先在图像的中心选取480×480 大小的像素尺寸进行裁剪,然后随机角度旋转,在x轴和y轴方向上随机最多平移20个像素,将其进行裁剪获得480×480 的图像。通过康奈尔数据集进行抓取框选择,最后数据集上的实验结果如表1所示:

抓取网络检测的部分抓取框结果如图5所示:

图5 康奈尔数据集的抓取框结果

2.2 现场实际抓取效果

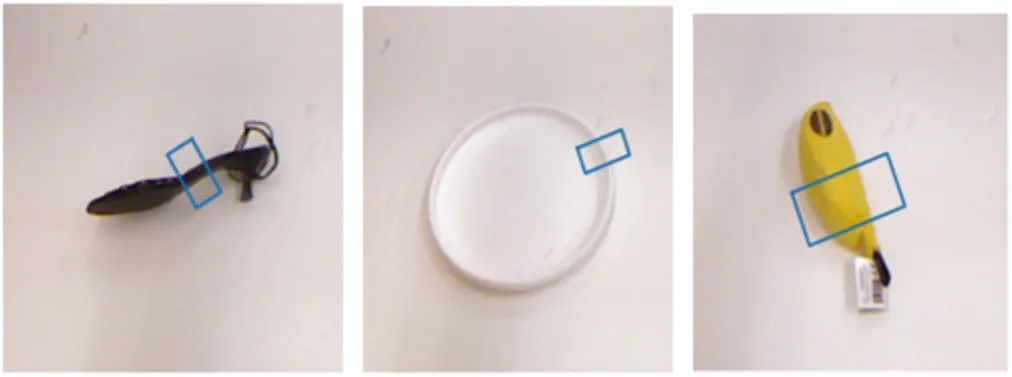

如表2所示:为了验证本文设计的机器人抓取检测算法的实际效果,实验结果表明,机器人抓取未知物体平均成功率为97.3%,其中抓取圆柱的准确率稍高,抓取圆筒的准确率稍低(96.7%),这个可能与被抓取物体的摩擦效果不同有关。上述结构已经充分说明本次设计的抓取网络Inception-ConCat-GraspNe 在实际应用中具有重要的实用价值和意义,抓取过程如下图6所示。

图6 实际机器人的抓取效果

表2 视觉机器臂实际抓取效果统计

本文设计了一种新颖的卷积模块Inception-ConCat 模块并加强为Inception-ConCat-GraspNe 模块,在此基础上采用编码解码结构设计整个深度神经网络。为了验证实验效果,在康奈尔公开数据集和实际的三维视觉机器人上进行实验,结果表明设计的抓取网络算法,其抓取准确率达到97.3%,在实际的机器人抓取实验中也取得了95.1%的实际精度,本次设计的机器人抓取算法有明显的优越性,具有重要意义和推广价值。

猜你喜欢 康奈尔卷积神经网络 基于递归模糊神经网络的风电平滑控制策略现代电力(2022年2期)2022-05-23基于3D-Winograd的快速卷积算法设计及FPGA实现北京航空航天大学学报(2021年9期)2021-11-02卷积神经网络的分析与设计电子制作(2019年13期)2020-01-14神经网络抑制无线通信干扰探究电子制作(2019年19期)2019-11-23从滤波器理解卷积电子制作(2019年11期)2019-07-04康奈尔的笑声延河(2019年6期)2019-06-28基于神经网络的中小学生情感分析电子制作(2019年24期)2019-02-23基于傅里叶域卷积表示的目标跟踪算法北京航空航天大学学报(2018年1期)2018-04-20最后一次笔会微型小说选刊(2015年33期)2015-11-17基于支持向量机回归和RBF神经网络的PID整定海军航空大学学报(2015年4期)2015-02-27